Col proliferare di contenuti generati dalle intelligenze artificiali, sono nate diverse iniziative a questo scopo, finora con poco successo

Caricamento player

Alle volte è sufficiente contare le dita. Le immagini generate dall’intelligenza artificiale (AI), infatti, fanno fatica a disegnare le mani e in generale, per quanto continuino a perfezionarsi, tendono a sbagliare alcuni dettagli, soprattutto quelli legati alle forme del corpo umano. Altre volte però non è così banale distinguere un’immagine sintetica – ovvero generata da un’AI – da una autentica.

È un problema sempre più sentito da molti fotografi, artisti e anche scrittori, che vorrebbero un modo per certificare i propri contenuti come “umani”. Inizialmente le piattaforme sembravano disposte a etichettare chiaramente i contenuti sintetici, ma col tempo questi hanno invaso i social network in quantità tale da renderlo impossibile. Lo scorso dicembre Adam Mosseri, capo di Instagram, ha ammesso che i sistemi per identificare i contenuti generati artificialmente avranno sempre meno effetto man mano che le AI diventeranno più potenti e che «sarà più pratico rilevare le impronte digitali dei contenuti reali che di quelli falsi».

Oggi non esiste uno standard universalmente accettato per certificare i contenuti creati dagli esseri umani. Ci sono però decine di iniziative e proposte, tutte piuttosto simili e con gli stessi limiti.

La più nota è la Coalition for Content Provenance and Authenticity (C2PA), un’organizzazione non profit fondata nel 2021 – cioè un anno prima della messa online di ChatGPT – da aziende come BBC, Adobe e Microsoft, con l’obiettivo di creare uno standard aperto (cioè liberamente disponibile per l’adozione) contro la disinformazione. Lo standard di C2PA si basa sull’aggiunta di metadati (le informazioni tecniche contenute nei file digitali) a immagini, video e file audio nel momento in cui vengono creati o alterati. Queste informazioni dovrebbero determinare se un contenuto è stato modificato o addirittura generato da un’AI, e quindi segnalarlo alle piattaforme su cui viene caricato, in modo che possano avvisare i loro utenti.

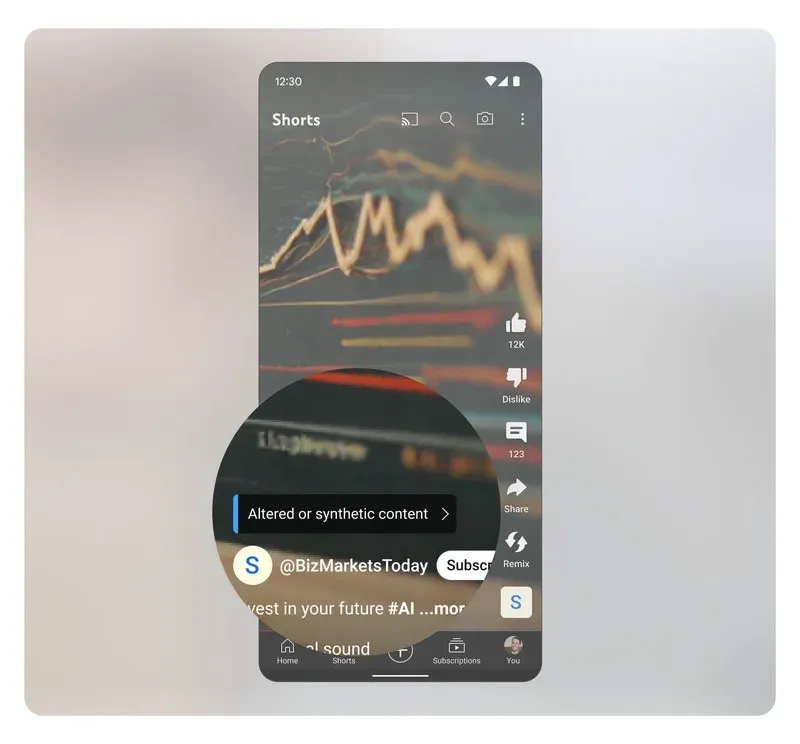

Ma è un sistema che si è rivelato poco efficace per alcuni motivi. Innanzitutto, ingannarlo è fin troppo semplice, anche perché i metadati in questione possono essere rimossi o modificati. Inoltre, molti utenti e le stesse piattaforme non sono incentivate a usarlo, dal momento che l’enorme quantità di contenuti generati artificialmente è un business per loro e non hanno nessun interesse a dichiararli come tali. Dal 2024, per esempio, YouTube invita gli utenti a segnalare come «alterati o sintetici» solo i contenuti che utilizzano le fattezze di una persona reale, modificano riprese di eventi o luoghi, o riproducono in modo credibile dei grandi eventi fittizi, «come un tornado che colpisce una città».

– Leggi anche: Stiamo appaltando la verità all’AI

(YouTube Shorts)

Le aziende tecnologiche sembrano essersi arrese all’idea di essere inondate dallo slop (“sbobba”), termine con cui si indicano dispregiativamente i contenuti sintetici di scarsa qualità, e hanno preferito lasciare agli artisti e ai creatori di contenuti tradizionali l’onere di certificare le proprie opere come umane. Negli ultimi anni sono nate altre iniziative simili a C2PA, ma nessuna è riuscita finora a risolvere il problema.

Tali proposte hanno spesso nomi che dimostrano una certa presa di posizione contro le AI, come “Not By AI”, “Proudly Human” (“orgogliosamente umano”), “AI-free”, “Human Written” e “HUMA Certificate”. Di solito, queste certificazioni puntano a essere usate per contenuti di ogni tipo, ma esistono anche proposte di settore. Per esempio “Human Authored” è pensata solo per i contenuti testuali: a crearla è stata l’Authors Guild, un’organizzazione statunitense professionale di scrittori.

Tutte queste iniziative sembrano avere gli stessi problemi di C2PA, se non di più. La certificazione Made by Human, ad esempio, si basa esclusivamente sulla fiducia e permette a chiunque di scaricare dal sito un logo da aggiungere alla propria opera. Nel caso di No AI, invece, l’utilizzo del certificato viene concesso solo dopo che l’opera in questione è stata controllata da software appositi, i quali però sono notoriamente poco affidabili nel riconoscere o meno se un contenuto è stato fatto con l’AI.

– Leggi anche: Le AI hanno imparato a generare immagini che sembrano foto brutte

Un altro esempio, Proof I Did It, si basa sulla blockchain, la tecnologia alla base delle criptovalute, e prevede di registrare in modo permanente la creazione e modifica delle immagini. Si tratta di un sistema simile a quello usato negli NFT (Non-Fungible Token), i certificati di proprietà per beni digitali basati sulla blockchain.

L’obiettivo di queste certificazioni è quello di creare un’etichetta simile a “Fair Trade”, che viene usata per identificare i prodotti del commercio equo e solidale. Fare lo stesso con un contenuto digitale è però complicato, anche perché il confine tra un’immagine generata con un’AI e una modificata (ad esempio, una foto resa più luminosa con Photoshop) può essere labile, specie per i sistemi di riconoscimento automatici delle piattaforme. Nel 2024 Meta cominciò ad aggiungere ad alcuni post la scritta “Fatto con l’A.I.”, ma il sistema che avrebbe dovuto riconoscere i contenuti sintetici si rivelò inadatto e finì per etichettare anche immagini che erano state solo leggermente modificate.

Un’altra questione poi è che sempre più persone hanno incluso gli strumenti AI nel loro processo creativo, senza per questo delegare del tutto la creazione di contenuti alle macchine. Il certificato Not by AI sembra accettare la pervasività delle AI nel processo creativo, concedendo la sua etichetta a qualunque contenuto che sia stato creato da umani «almeno al 90 per cento».

– Leggi anche: Come si insegna a un chatbot a essere buono?